La figura de 'El Lobo de Wall Street' pasó a ser conocida en todo el mundo después de que Leonardo DiCaprio lo interpretara en la película de Martin Scorsese. Basada en una historia real, la estrella de Hollywood se puso en la piel de un empresario sin escrúpulos -Jordan Belfort- que se enriqueció a base de estafar a miles de personas con la venta de acciones fraudulentas a través de su compañía Stratton Oakmont. Aunque la firma cerró en 1996, los coletazos de su actividad todavía se sienten hoy, en este caso por lo que acabó provocando una denuncia que la compañía puso unos años antes de desaparecer.

A principios de los 90, la empresa de Belfort llevó a los tribunales por difamación a la proveedora de Internet Prodigy Services. Lo hizo después de que un usuario anónimo publicara allí un mensaje en el que acusaba a Stratton Oakmont de haber cometido delitos y actividades fraudulentas (lo que el paso del tiempo demostró no haber sido ninguna mentira). La Corte Suprema de Nueva York dictaminó que Prodigy Services era la responsable de ese mensaje difamatorio porque, al funcionar como una editora y establecer límites, ejercía control sobre los contenidos que se publicaban en su web. Si no hubiera realizado ningún tipo de acción, si hubiera funcionado como lo hacen las redes, posiblemente no habría recibido ninguna sanción.

La denuncia de Stratton Oakmont acabó provocando que se promulgara una legislación, la Sección 230 de la Ley de Decencia en las Comunicaciones, que con los años ha permitido florecer y expandirse a las redes sociales hasta convertirse en lo que son hoy: plataformas digitales gigantescas con capacidad de influir sobre millones de personas. Y una de las piezas que regula y protege su actividad esencial fue redactada antes de que fueran creadas.

La Sección 230

Preocupados de que la decisión judicial que penalizó a Prodigy Services condujera a que los portales web no bloquearan ningún tipo de contenido para así evitar ser sancionados, dos congresistas (uno demócrata y otro republicano) acabaron incorporando en 1996 la Sección 230 a la Ley de Decencia en las Comunicaciones para proteger a las webs frente a lo que un tercero publicara en ellas, aunque incluyeran material extremista o difamatorio. Pretendían que la responsabilidad recayera únicamente en el emisor del mensaje, no en el que facilitaba el canal a través del cual éste se transmitía. Esencialmente, esta cláusula legal, agregada a la normativa federal en los albores de internet, mucho antes de que existieran las redes sociales, hoy las blinda ante los tribunales.

Y las blinda porque la Sección 230 consta, además, de una segunda parte por la cual otorga inmunidad a los "proveedores de servicios de información" que eliminen contenido si lo consideran "obsceno, lujurioso, lascivo, sucio, excesivamente violento, acosador o de otro modo objetable, sin importar si dicho material está o no protegido constitucionalmente". Lo pueden hacer siempre y cuando esta acción se realice "de buena fe".

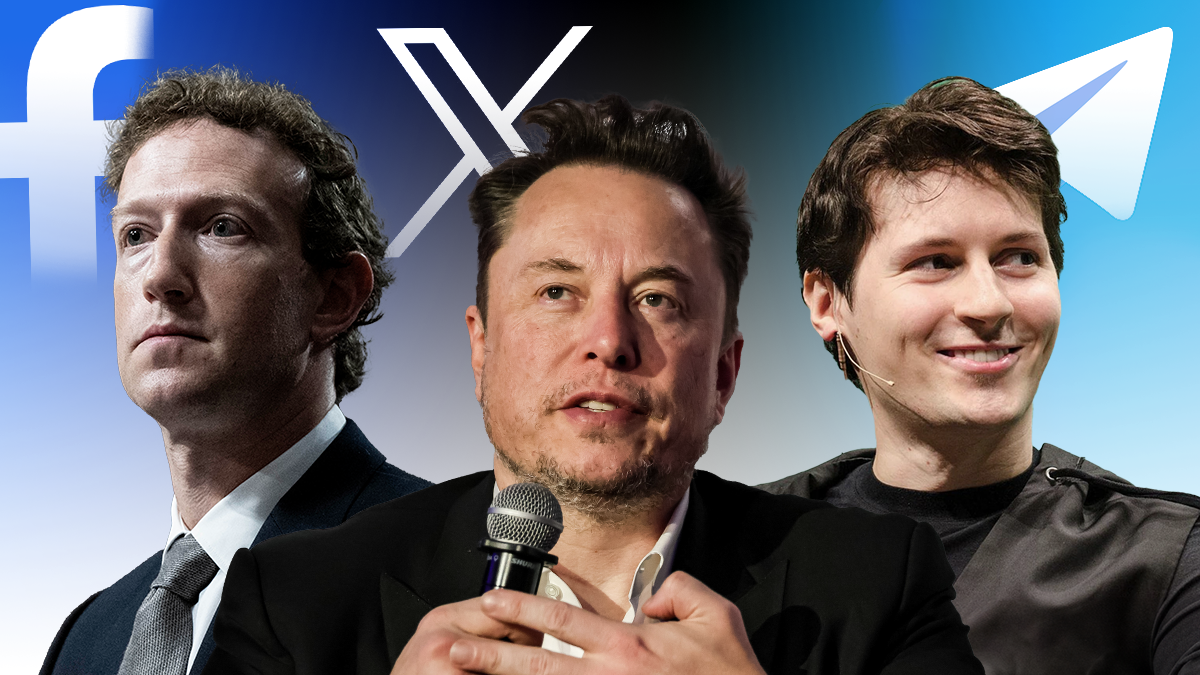

Esta prerrogativa le da a X, Facebook y el resto de redes mucho poder a la hora de controlar lo que los usuarios ven y, al mismo tiempo, las exime de cualquier responsabilidad si eliminan contenido. Pueden elegir qué moderan o eliminan, y al mismo tiempo no ser responsables de lo que no moderen, salvo el contenido que promueve el tráfico sexual o viole los derechos de autor. Quitando estos dos casos, no tienen que responder ante nadie. Son intocables. O lo eran.

El debate sobre la libertad de expresión

Desde su creación, las redes sociales han estado bajo la mirada de los políticos, temerosos de lo que se publique en ellas les perjudique electoralmente. Son un espacio incontrolable donde se vierte todo tipo de información, y los intentos por regular su contenido en Europa y Estados Unidos han sido en vano, lo que no significa que no se haya intentado. O que no las hayan presionado. En mayo de 2020, cuando era presidente, Donald Trump quiso introducir cambios legales para limitar su protección. Recientemente, Mark Zuckerberg, fundador y CEO de Facebook, reconoció que el gobierno de Joe Biden presionó a la compañía para que censurase contenidos durante la pandemia. Elon Musk, propietario de X, está en plena batalla contra un juez de Brasil que ha decretado el cierre de la red social en el país y que llegó a amenazar con detener a uno de los ejecutivos de la compañía si no eliminaba cierto contenido.

Pero lo que ha hecho saltar las alarmas y poner sobre la mesa el debate de la regulación de las redes ha sido la detención en Francia de Pável Dúrov, creador y CEO de Telegram. El caso de esta aplicación de mensajería es diferente al de X y Facebook, puesto que al tener su base en los Emiratos Árabes Unidos, siempre se ha protegido de la Unión Europea y EE.UU, y se ha convertido en un emplazamiento digital que facilita la difusión viral de cualquier tipo de contenido, ideal para todo aquel que quiera propagar contenidos falsos o engañosos.

Lo cierto es que cuando una red social modera o elimina contenido, su funcionamiento no dista mucho del que pueda realizar un medio de comunicación. Sin embargo, la legislación que los regula es muy diferente. No intervenir y proteger la identidad de los usuarios, aunque estos estén cometiendo hechos delictivos, puede conducir a que, como ha argumentado la fiscalía francesa en el caso de Telegram, éstas se conviertan en un espacio donde se propague la pornografía infantil, el odio en línea o se facilite el narcotráfico.

El debate está servido. Elon Musk ha declarado en múltiples ocasiones que compró Twitter para salvaguardar la libertad de expresión en Estados Unidos, que es el argumento al que se han aferrado los abogados de las redes sociales cada vez que las han llevado a los tribunales por un caso de esta índole. Dónde trazar la línea que separa este derecho fundamental del delito siempre ha sido una cuestión delicada y difusa. Hoy, con las redes sociales dominando el panorama mediático, y sometidas a un régimen jurídico distinto, lo es aún más.

Te puede interesar

1 Comentarios

Normas ›Comentarios cerrados para este artículo.

Lo más visto

- 1 El Independiente | El diario digital global en español

- 2 Avance de La Promesa el próximo lunes

- 3 El precedente de La Promesa que abre la puerta a un personaje

- 4 El Supremo espera la prueba "definitiva" del WhatsApp de García Ortiz antes de un mes

- 5 Avance de Sueños de libertad este lunes 31 de marzo

- 6 Máxima tensión entre ganaderos y ecologistas por la caza del lobo

- 7 La cotización del libro 'prohibido' de Luisgé Martín se dispara en el 'mercado negro': "Si alguien lo necesita, este es el precio"

- 8 Sánchez hará lo posible para que Oughourlian no gane en Prisa

- 9 Ya hemos visto Manual para señoritas y este es nuestro veredicto

![La Guardia Civil recorrió 100 kilómetros "de finca en finca" para dar [...]](https://www.elindependiente.com/wp-content/uploads/2025/03/guardia-civil-yihadista-francia-350x365.jpg)

![La becaria que denunció a Nacho Cano interpone una denuncia por delito [...]](https://www.elindependiente.com/wp-content/uploads/2025/03/europapress-6448969-lesly-ochoa-atiende-medios-llegada-juzgados-plaza-castilla-13-enero-2025-350x365.jpg)

![El Supremo da diez días a Sánchez para que se haga cargo [...]](https://www.elindependiente.com/wp-content/uploads/2025/02/europapress-6433212-varios-servicios-emergencia-atienden-migrantes-recien-rescatados-cayuco-350x365.jpg)

![La Universidad de Valencia informa a la jueza que suspendió las clases [...]](https://www.elindependiente.com/wp-content/uploads/2025/03/varias-personas-colaboran-labores-limpieza-31-octubre-2024-aldaia-valencia-350x365.jpg)

![La Guardia Civil intercepta en el Atlántico un narcosubmarino con 6,6 toneladas [...]](https://www.elindependiente.com/wp-content/uploads/2025/03/secuencia-0103-47-38-13imagen-fija087-350x365.jpg)

![La Fiscalía recurre la decisión del juez y pide a la Audiencia [...]](https://www.elindependiente.com/wp-content/uploads/2025/03/jose-breton-350x365.webp)

![José Bretón, la creación literaria y el honor de las víctimas: "Ha [...]](https://www.elindependiente.com/wp-content/uploads/2025/03/jose-breton-libro-v2-350x365.jpg)

![El juez le vuelve a pedir a Errejón que entregue su móvil [...]](https://www.elindependiente.com/wp-content/uploads/2025/03/europapress-6576221-actriz-elisa-mouliaa-llega-juzgados-plaza-castilla-entregar-movil-juez-caso-350x365.jpg)

hace 7 meses

Como hoy en día los periódicos no son más que panfletos quebrados que nadie lee y que viven de las subvenciones, ven con envidia como las redes sociales les han sustituido en credibilidad e influencia. Por eso no extraña que tantos columnistas que ven en riesgo sus habichuelas se manifiesten a favor de la censura de las plataformas digitales.

En el caso de X (antigua Twitter), no recuerdo que nadie protestara cuando era propiedad del progre Patrick Dorsey y se dedicaba a censurar contenidos de derechas. El doble rasero de siempre.