Desde siempre, en el fútbol se insulta. Lo hacen los jugadores (entre sí y al árbitro) y lo hacen, por supuesto, los aficionados desde las gradas. En los últimos años en España los cánticos más agresivos (racistas, machistas, homófobos, etc) ya no están pasando inadvertidos, y a la condena social se le están sumando las sanciones económicas y deportivas a aficionados y clubes. Pero aunque el avance es innegable, la situación está lejos de ser controlada.

Quizás el máximo exponente de todo esto en España sea Vinicius Jr. Desde que llegó a nuestro país en 2018, el jugador del Real Madrid ha ido creciendo hasta convertirse en uno de los mejores futbolistas del mundo (por algo es el máximo favorito para ganar el Balón de Oro de este año). Pero a la vez también se ha convertido en uno de los enemigos favoritos de algunas aficiones españolas. Pensar que esos miles de personas que le insultan a él y a muchos otros cada jornada van a dejar de hacerlo pronto no parece realista. Y ahí surge otra opción de la mano de la tecnología, que podría resolverlo, pero que también plantea muchas dudas legales y éticas.

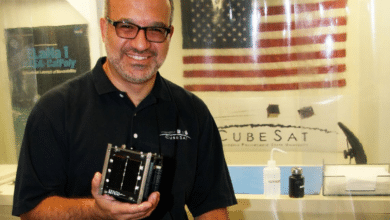

"El reconocimiento facial permitiría identificar a la gente de las gradas. Es la tecnología más fiable en estos momentos, y lo que hace es que compara las imágenes que capturas con las cámaras con las que tienes en tu base de datos hasta encontrar la coincidencia. Pero luego hay herramientas como Aware que permiten buscar a algunas personas en concreto creando etiquetas, como el color de la ropa o el sexo. Puedes pedirles, por ejemplo, que te saque imágenes de todas las mujeres o de todos los que llevan un pantalón azul o una camiseta roja", asegura Álvaro Mocholi, CEO de Grekkom, una empresa especializada en video análisis en tiempo real.

Estas tecnologías utilizan inteligencia artificial, que permite, además de entrenar los propios modelos, acelerar todo el proceso autoclasificando las imágenes en lugar de tener que hacer una revisión manual de todas ellas, algo que llevaría horas. De acuerdo con Mocholi, no sería complicado implementar estos sistemas en los estadios de fútbol como los de Primera División. Bastaría con instalar el software y unos servidores robustos, porque incluso podrían aprovecharse las cámaras existentes "siempre y cuando tengan una resolución mínima".

No obstante, el experto apunta que estas herramientas solo pueden usarse actualmente en temas de seguridad y análisis forense, según la Ley de protección de datos. Algo que explicaría su uso tan limitado, especialmente en grandes eventos. Sin embargo, Carmela Troncoso, profesora e investigadora de ingeniería de seguridad y privacidad en la Escuela Politécnica Federal de Lausana (Suiza), explica que la razón es su falta de fiabilidad. Por eso, afirma, a pesar de que han dado mucho que hablar, solo se están utilizando en contextos muy concretos.

"A la hora de identificar, estas tecnologías pueden tener muchos fallos. Estamos mas acostumbrados a verlas en el ámbito de la autenticación (como el desbloqueo del teléfono con la cara), donde funcionan muy bien. Pero esa es una tarea fácil. La identificacion 'in the wild' es mucho mas difícil, porque hay que buscar esa cara en una imagen que puede no ser clara (mala luz, mal ángulo, objetos por el medio, etc). En ese momento la tecnología pierde fiabilidad, y más aún cuando se trata de reconocer a minorías (con respecto a las muestras que se hayan usado para entrenar el modelo). Y los fallos, especialmente los positivos (identificar a la persona que no es) pueden generar muchos problemas, como falsas acusaciones", sostiene.

El reconocimiento facial podría usarse para más cosas, más allá de detectar los insultos desde la grada. Por ejemplo, para verificar que la entrada corresponde con el comprador y evitar así las reventas. O para evitar que las personas que tienen prohibido el acceso a los estadios puedan acabar entrando, una tarea que hoy en día es realmente complicada. En cualquier caso, todas estas aplicaciones podrían necesitar la creación de bases de datos con información de la gente. Algo que, como apuntan desde Veridas, una compañía especializada en autenticación digital, sería complicado porque requeriría la autorización de los propios usuarios, y esos datos deberían ser almacenados por los propios clubes de fútbol.

El intento de LaLiga de usar el reconocimiento facial

En octubre de 2023 el periódico Economía Digital publicó una noticia que aseguraba que LaLiga había sacado un concurso para adjudicar un contrato de tres años a un proveedor de sistemas biométricos para desarrollar un sistema de reconocimiento facial. La idea era utilizarlo en el acceso de los aficionados a los estadios, pero el mismo medio informaba de que en la decisión habían tenido mucho que ver los incidentes ocurridos en campos de fútbol de carácter xenófobo y otros sucesos.

Meses después, en enero de 2024, la Agencia Española de Protección de Datos emitió un comunicado en el que lanzaba una "advertencia" a LaLiga de fútbol. En el comunicado les recordaba que un sistema de estas características debía de ajustarse a la legalidad o estarían incurriendo en una infracción, lo que daría lugar a una investigación que podría acabar conllevando una sanción. Por eso les sugerían que apostaran por una tecnología menos intrusiva.

En febrero de este año LaLiga acabó suspendiendo el concurso, y desde entonces no se había sabido nada más. Por eso El Independiente ha contactado directamente con ellos para conocer sus planes futuros. Desde la propia compañía han explicado que siguen teniendo intención de implementar esta tecnología en los campos, aunque detallan que es un proyecto "complejo porque, entre otras cosas, tiene la dificultad de hacerlo compatible con la Ley Orgánica de Protección de Datos de Carácter Personal (LOPD)". Precisamente por eso se abstienen de decir qué usos le darían, aunque reiteran que tendrían que estar en línea con esta normativa.

Problemas éticos

Hace unos días el escritor israelí Yuval Noaḥ Harari, autor de Sapiens, habló durante la presentación de su nuevo libro sobre su preocupación acerca del potencial de la IA como herramienta "totalitaria". Y puso el ejemplo de Israel e Irán, que de acuerdo con él ya están construyendo regímenes en los que los ciudadanos están hipervigilados gracias a tecnologías como el reconocimiento facial.

La preocupación de Harari está bastante extendida. Y las incógnitas que se generan siempre con estos temas en materia de privacidad, seguridad y derecho al anonimato aún no están resueltas. "Más allá de los errores de estas tecnologías, es un gran problema que para desplegarlas haga falta que exista la captura de imagen. Y ahí está la cuestión, porque en el momento en el que no existen espacios privados, la sociedad cambia", resume Troncoso.

La experta lo compara con los edificios panópticos, un modelo de prisión que permite al guardián observar a todos los prisioneros sin que estos lo sepan. Fue concebido a finales del siglo XVIII por el filósofo británico Jeremy Bentham, que confiaba en que este tipo de arquitectura tendría muchos usos: escuelas, manicomios, fábricas, hospitales... "Como dice Daniel J.Solove - profesor de propiedad intelectual y derecho tecnológico en la Universidad George Washington (EE.UU)-, el problema no es tanto llegar a un gran hermano como el que describe George Orwell. Sino más bien tener algo parecido a lo que relataba Franz Kafka en su libro El proceso. El no saber qué te vigila y qué puede pasar tiene un efecto poderosísimo en nosotros y en la sociedad. Un mundo vigilado no es el mundo en el que vivimos ahora", desliza.

Por todo ello, Troncoso tiene clara su postura si se le cuestiona por el futuro de sistemas como el reconocimiento facial: "Espero que poco a poco se limite su uso a ámbitos en los que sepamos a ciencia cierta (literalmente, con pruebas científicas) que son fiables, y donde su implantación no suponga cambiar las convenciones sociales en las que vivimos. Pero para eso tiene que pasar el bombo que se le da ahora a estas tecnologías, y las tenemos que ver como lo que son: no son magia, ni tienen capacidad de cambiar el planeta. Son apoyos que pueden mejorar, pero no siempre el mejor camino es digitalizarlo todo. Igual que en medicina o transporte, donde la sociedad ha decidido que ciertos caminos no son éticos y no deben tomarse, en la digitalización tenemos que llegar a un compromiso similar".

Te puede interesar

6 Comentarios

Normas ›Comentarios cerrados para este artículo.

Lo más visto

- 1 Peinado llega a la Moncloa para tomarle declaración a Bolaños

- 2 El ejército español se reincorpora a las mayores maniobras en África pero evita Marruecos

- 3 Sanidad ordena retirar varias sopas y caldos de los supermercados

- 4 La "decadencia intelectual" de Mario Vargas Llosa: "Fue perdiendo la memoria"

- 5 La Promesa: avance del capítulo 579 el próximo lunes 21 de abril

- 6 La Promesa: RTVE confirma la duración de la última temporada

- 7 El juez Peinado multa a Vox y Hazte Oír con 500 euros y al abogado de Begoña Gómez con 5.000

- 8 Los pensionistas que recibirán en el mes de abril 140 euros extra

- 9 La abeja robot o cómo la realidad supera a 'Black Mirror'

![El Barça lanza su propia operadora de telefonía: ¿filón de negocio o [...]](https://www.elindependiente.com/wp-content/uploads/2025/04/photo-2025-04-10-21-25-50-1-350x365.webp)

![Telefónica pierde 58 millones de clientes tras la venta de sus filiales [...]](https://www.elindependiente.com/wp-content/uploads/2025/04/celebracion-junta-accionistas-2025-3-copia-350x365.jpg)

![Telefónica confirma también la venta de su filial en Perú por 900.000 [...]](https://www.elindependiente.com/wp-content/uploads/2025/04/celebracion-junta-accionistas-2025-7-copia-350x365.jpg)

![La auténtica guerra entre EEUU y China: el pulso por la hegemonía [...]](https://www.elindependiente.com/wp-content/uploads/2025/04/pulso-trump-presi-chino3-350x365.jpg)

![Murtra orienta a Telefónica hacia Europa para luchar contra los "titanes casi [...]](https://www.elindependiente.com/wp-content/uploads/2025/04/celebracion-junta-accionistas-2025-1-350x365.jpg)

![La gran mayoría de los accionistas de Telefónica respalda a Marc Murtra, [...]](https://www.elindependiente.com/wp-content/uploads/2025/01/50278c01804a7e1919e8ad60492fe500e8a775afw-350x365.jpg)

![La junta de accionistas de Telefónica ratifica a Murtra y a su [...]](https://www.elindependiente.com/wp-content/uploads/2025/03/marc-murtra-1-350x365.jpg)

![Murtra promete a los accionistas que Telefónica tendrá una "disciplina financiera de [...]](https://www.elindependiente.com/wp-content/uploads/2025/02/resultados-4t-2024-foto-7-350x365.jpg)

hace 7 meses

La inteligencia que podria acabar con los insultos a Vinicius no es la artificial sino la natural del própio jugador.Si a los mas de dos centenas de futbolistas de raza negra que juegan en el futbol profesional español solo pitan a Vinicius,está claro que la cosa no va de racismo sino de la actitud del jugador que se pasa los partidos gesticulando y protestándole a los colegiados.

Que cambie su modo de comportarse en el campo y ya verá como van desapareciendo esos pitos y esos insultos.

hace 7 meses

¿La IA acabará también con las provocaciones de Vinicius?

hace 7 meses

@nadieesmejorquenadie. Lee un poco so zoquete, pedazo tarugo. Donde está el racismo con el resto de jugadores del RMadrid? Solo con Vinicius? Pedazo ZOTE

hace 7 meses

Jajajajaja claro Lombroso

Lo mismo les pasa a las mujeres, provocan

Es un poco fácil la disculpa. Yo no soy racista, eres tú que me provocas

Yo no soy machista, es ella que no me hace caso…..

En fin, cuanta mierda que limpiar

hace 7 meses

¿Racismo?, yo no veo que insulten al.resto de jugadores del Madrid por su color de piel, Vinicius tiene un problema, y es que no sabe comportarse y provoca a la gente. Ese es el contexto y debate de este problema

hace 7 meses

Entonces la opción de educar y ser respetuoso la damos ya por perdida?